Stable Diffusionをローカルで動かしてみたいんですけど、なんだか難しそうで一歩踏み出せなくて……。私のPCでも動きますか?

大丈夫ですよ。手順さえわかれば1〜2時間で完了します。今日はPCスペックの確認からインストール、最初の1枚の生成までをまるごとご案内しますね。

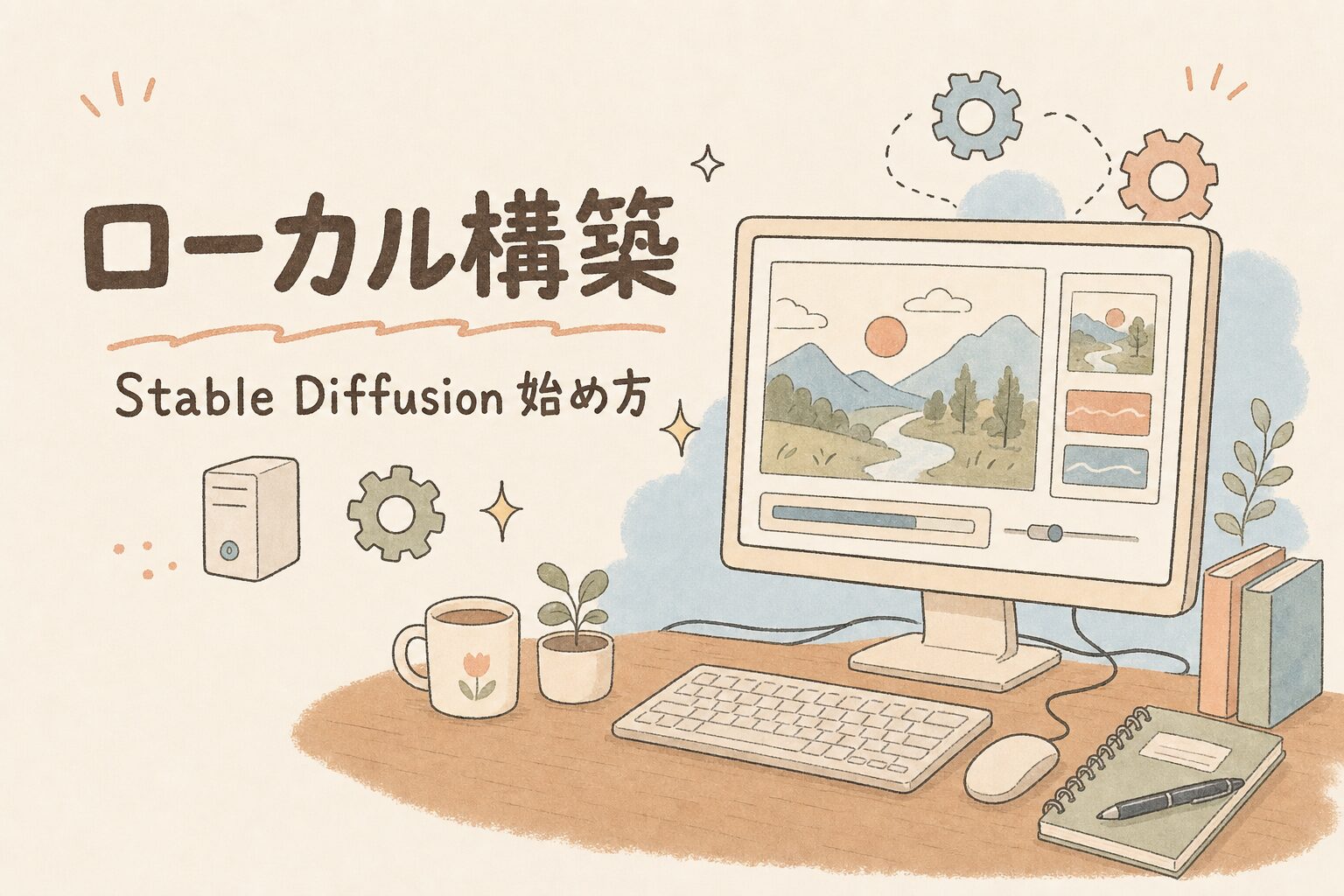

「Stable Diffusionをローカルで動かしてみたいけど、なんだか難しそう……」

「PCのスペックは足りるのかな?インストール手順がよくわからない」

そう思って一歩踏み出せずにいませんか?

実はStable Diffusionのローカル環境構築は、手順さえわかれば1〜2時間ほどで完了します。一度入れてしまえば、無料で枚数無制限・商用利用OKの自分専用画像生成AIが手に入りますよ。

この記事では、AIツールにまだ慣れていない方でも迷わず進められるように、必要なスペックからインストール手順、最初の画像生成まで丁寧に解説していきますね。

- Stable Diffusionをローカルで動かすメリットとデメリット

- 必要なPCスペックの目安(Windows・Mac別)

- AUTOMATIC1111版 Web UIのインストール手順

- 最初の画像生成までの流れ

- つまずきやすいポイントと対処法

Stable Diffusionとは?まず基本をおさらい

Stable Diffusion(ステーブル・ディフュージョン)は、テキスト(プロンプト)を入力するだけで高品質な画像を生成できるAIです。2022年にStability AI社からリリースされ、今では世界中のクリエイターに使われています。

特徴をざっくりまとめるとこんな感じです。

| 項目 | 内容 |

|---|---|

| 開発元 | Stability AI |

| 料金 | 無料(オープンソース) |

| 商用利用 | 可能(モデルにより条件あり) |

| 動作環境 | ローカルPC・クラウド・ブラウザ |

| 生成速度 | GPU性能に依存 |

ChatGPTやMidjourneyと違って「自分のPCで動かせる」のが最大のポイント。データを外部に送らずに済むので、プライバシー面でも安心なんです。

ポイント

Stable Diffusionは無料で使えるオープンソースの画像生成AI。ローカル環境なら枚数制限もなく、自分だけの画像生成スタジオとして自由に使えます。

ローカル環境で動かす3つのメリット

「ブラウザ版でいいんじゃない?」と思う方もいるかもしれません。でもローカル環境には、ブラウザ版では得られないメリットがたくさんあるんですよ。

メリット1:完全無料で枚数無制限

ブラウザ版やクラウドサービスは、無料枠を超えると課金が発生します。一方ローカル環境なら、電気代以外はかかりません。1日100枚生成しても、1万枚生成しても無料です。

「とにかく数を作って試したい」「練習用にどんどん生成したい」という方には、ローカル環境がぴったりです。

メリット2:プライバシーが守られる

生成した画像もプロンプトも、すべて自分のPC内で完結します。仕事の資料用画像や、人に見せたくないアイデアスケッチも安心して試せますね。

クラウドサービスだと「入力したプロンプトが学習に使われるのでは……」と気になる方もいると思いますが、ローカル環境ならその心配は無用です。

メリット3:自由にカスタマイズできる

LoRAやモデルの追加、拡張機能(Extensions)の導入、設定の細かい調整など、ローカル環境なら何でも自由にできます。「こういう絵柄を出したい」を突き詰められるんです。

| 比較項目 | ローカル環境 | ブラウザ版 |

|---|---|---|

| 料金 | 無料 | 一部有料 |

| 枚数制限 | なし | あり |

| カスタマイズ性 | 高い | 低い |

| 初期設定 | やや手間 | ほぼ不要 |

| プライバシー | 完全保護 | サービス依存 |

初期設定こそ少し手間ですが、長く使うほどお得で自由度も高いのがローカルの魅力です。AIで本格的に創作したい方には特におすすめですよ。

ポイント

ローカル環境は「完全無料」「プライバシー保護」「自由なカスタマイズ」の三拍子。長く使うほどコスパも自由度も高くなります。

デメリットも正直にお伝えします

メリットだけ書くのはフェアじゃないので、デメリットもしっかりお伝えしますね。

ローカル環境のデメリット4つ

- PCスペックが必要:特にGPU(グラフィックボード)が重要

- 初期設定に時間がかかる:1〜2時間ほど見ておきましょう

- トラブル時は自分で解決:エラーが出たときは検索が必須

- ストレージを圧迫する:モデルを増やすと数十GB単位で消費

ただ、どれも「最初だけ」のハードルです。一度乗り越えれば、あとは快適に使えますよ。

もし「うちのPCでは厳しいかも……」と感じたら、後半で紹介するクラウド版・ブラウザ版の代替案も検討してみてください。いきなりローカルに挑戦せず、まずはお試しから始めるのも賢い選択です。

ポイント

デメリットの多くは初期段階だけ。慣れれば気にならなくなりますし、PCスペックが厳しい場合はクラウド版という選択肢もあります。

必要なPCスペックの目安

ここが一番気になるところですよね。「私のPCで動くの?」を確認していきましょう。

最低限のスペック(とりあえず動く)

| パーツ | 最低スペック |

|---|---|

| OS | Windows 10/11、macOS、Linux |

| GPU | NVIDIA製 VRAM 4GB以上 |

| メモリ(RAM) | 8GB |

| ストレージ | 空き20GB以上 |

| CPU | 4コア以上 |

このスペックでも動きはしますが、生成に時間がかかります。1枚あたり1〜2分かかることも珍しくありません。

推奨スペック(快適に使える)

| パーツ | 推奨スペック |

|---|---|

| OS | Windows 11 |

| GPU | NVIDIA RTX 3060以上 VRAM 12GB |

| メモリ(RAM) | 16GB以上 |

| ストレージ | SSD 500GB以上 |

| CPU | Core i5〜i7 / Ryzen 5以上 |

このくらいあれば、1枚10〜20秒で生成できます。SDXLという高画質モデルを使うならVRAM 12GBは欲しいですね。

Macユーザーへの注意

MacでもM1/M2/M3チップのモデルなら動きます。ただしWindowsのNVIDIA GPUと比べると、生成速度は遅めです。M2 Pro以上で実用的に使えるレベルだと思っていてくださいね。

VRAM選びの落とし穴に注意

「とりあえず動けばいいや」でVRAM 4GBのGPUを選ぶと、後々SDXLや大きい画像サイズが扱えず、結局買い替えになりがちです。これからGPUを買う方は、VRAM 12GB以上を強くおすすめします。1〜2万円の差をケチると後悔しますよ。

うちのノートPC、VRAM 4GBしかないんですけど……どうしたらいいですか?

SD1.5系の小さいモデルなら動きますし、後ほど紹介する --medvram オプションを使うとVRAMの負担を減らせますよ。それでも厳しい場合はクラウド版の Google Colab を試すのもアリです。

ポイント

GPU(特にVRAM容量)が最重要パーツ。RTX 3060以上が安心の目安です。MacはM2 Pro以上を選びましょう。

事前に準備するもの

インストール作業に入る前に、以下の3つを準備しておきましょう。

準備するもの3点セット

- Python 3.10.6(バージョンが重要!)

- Git for Windows(ソースコードの取得用)

- 保存先フォルダ(Cドライブ直下がおすすめ)

特にPythonは「3.10.6」を入れてください。新しいバージョンだとエラーが出ることがあるんです。「最新版でいいや」と思って3.11や3.12を入れると、後でハマります。

| ツール | ダウンロード先 | バージョン |

|---|---|---|

| Python | python.org | 3.10.6 |

| Git | git-scm.com | 最新版でOK |

Pythonバージョンの注意

Stable Diffusion Web UI(AUTOMATIC1111版)は Python 3.10.6で動作確認されているため、それ以外のバージョンでは依存関係エラーが起きやすいです。すでに新しいPythonが入っている場合も、3.10.6を追加でインストールするのが安全です。

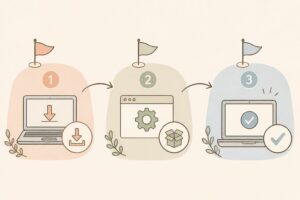

Stable Diffusion Web UI(AUTOMATIC1111版)のインストール手順

ここからが本番です。今回は最も人気のある「AUTOMATIC1111版 Stable Diffusion Web UI」を導入していきますね。

ステップ1:Pythonのインストール

- python.orgにアクセス

- 「Python 3.10.6」のWindows installer (64-bit)をダウンロード

- インストーラーを起動

- 「Add Python to PATH」に必ずチェックを入れる

- 「Install Now」をクリック

このPATHのチェックを忘れると、後でコマンドが認識されません。要注意ポイントです。

ステップ2:Gitのインストール

- git-scm.comにアクセス

- Windows版をダウンロード

- インストーラーを起動

- 設定はすべてデフォルトのまま「Next」を連打

- 完了

Gitは特に難しい設定はないので、サクッと進めて大丈夫ですよ。

ステップ3:Web UIのダウンロード

- Cドライブ直下に「stable-diffusion」というフォルダを作成

- フォルダ内で右クリック →「Open Git Bash here」を選択

- 以下のコマンドを入力してEnter

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.gitこれでWeb UIのファイル一式がダウンロードされます。回線速度にもよりますが、数分で終わりますよ。

ステップ4:モデルファイルの配置

Stable Diffusionは「モデル」と呼ばれるファイルがないと画像を生成できません。

- Hugging FaceやCivitaiから好きなモデルをダウンロード

- ファイルサイズは2〜7GBほど

stable-diffusion-webui\models\Stable-diffusionフォルダに配置

最初は「Stable Diffusion 1.5」や「SDXL Base 1.0」など、定番モデルから試すのがおすすめです。

ステップ5:起動!

stable-diffusion-webuiフォルダ内の「webui-user.bat」をダブルクリック- 黒い画面(コマンドプロンプト)が起動

- 必要なファイルが自動でダウンロードされる(初回は10〜20分かかります)

- 「Running on local URL: http://127.0.0.1:7860」と表示されたら成功

- ブラウザでそのURLを開く

お疲れさまでした!ここまで来れば、もう画像生成ができますよ。

ポイント

webui-user.batの初回起動は10〜20分かかります。「フリーズしてる?」と思っても触らず気長に待ちましょう。2回目以降は数十秒で起動します。

最初の1枚を生成してみよう

ブラウザにWeb UIが表示されたら、さっそく試してみましょう。

基本操作

- 上部の入力欄(Prompt)に英語でキーワードを入力

- 「Generate」ボタンをクリック

- 数十秒待つと画像が生成される

たとえばこんなプロンプトを試してみてください。

a cute cat sitting on a window, sunlight, photorealistic, high quality主要なパラメータの意味

| 項目 | 意味 | 初心者のおすすめ値 |

|---|---|---|

| Sampling steps | 生成のステップ数 | 20〜30 |

| CFG Scale | プロンプトへの忠実度 | 7 |

| Width / Height | 画像サイズ | 512×512(SD1.5)/ 1024×1024(SDXL) |

| Batch count | 生成枚数 | 1〜4 |

| Seed | ランダム値 | -1(毎回ランダム) |

最初は深く考えず、デフォルト値のままでOKです。慣れてきたら少しずつ変えてみましょう。

うわ、本当に画像が出てきました!プロンプトって英語じゃないとダメですか?

日本語でもある程度は動きますが、英語のほうが圧倒的に精度が高いです。慣れないうちはDeepLやChatGPTで翻訳してもらうのが楽ですよ。

ポイント

プロンプトは英語が基本。最初は短くシンプルに書くのがコツです。慣れてきたら「lighting」「composition」など細かい指示を足していきましょう。

つまずきやすいポイントと対処法

導入時によくあるトラブルと、その対処法をまとめておきますね。

トラブル1:webui-user.batが起動しない

原因と対処

原因:Pythonのバージョンが違う、PATHが通っていない

対処:Python 3.10.6を入れ直して、PATHのチェックを忘れずに

トラブル2:「CUDA out of memory」エラー

原因と対処

原因:GPUのVRAM不足

対処:画像サイズを小さくする、--medvramオプションを追加

webui-user.batをメモ帳で開いて、COMMANDLINE_ARGS=の部分に--medvramと書き足してください。VRAMが特に少ない場合は--lowvramもあります(さらに軽くなる代わりに生成は遅くなります)。

トラブル3:生成がとても遅い

原因と対処

原因:CPU動作になっている可能性

対処:NVIDIA GPUのドライバを最新に、CUDAが認識されているか確認

トラブル4:英語ばかりでわかりにくい

対処:Extensionsから「ja_JP Localization」をインストールしましょう。日本語化することで、ぐっと使いやすくなりますよ。

| トラブル | 主な原因 | 対処法 |

|---|---|---|

| 起動しない | Pythonのバージョン違い | 3.10.6を入れ直す |

| メモリエラー | VRAM不足 | 画像サイズ縮小・–medvram |

| 生成が遅い | CPU動作 | GPUドライバ更新 |

| 英語ばかり | 未日本語化 | 日本語拡張機能を導入 |

ポイント

エラーメッセージは検索すれば必ず情報が見つかります。落ち着いてエラー本文をコピペしてGoogle検索しましょう。日本語の解説記事も豊富です。

ローカル環境を快適にする3つの追加設定

無事に動いたら、次のステップに進みましょう。これをやっておくと、ぐっと快適になりますよ。

1. 日本語化拡張機能の導入

「Extensions」タブから「ja_JP Localization」を検索してインストール。再起動後、Settings → User interfaceから言語を変更します。

2. 追加モデルのダウンロード

Civitai(civitai.com)には、何千ものモデルが無料で公開されています。アニメ風、リアル系、イラスト風など、目的に応じて選びましょう。

3. LoRAの活用

LoRA(ローラ)は、特定のキャラクターやスタイルを学習させた小さなファイルです。容量も100〜200MB程度で、好きな画風を簡単に追加できますよ。

ポイント

日本語化・追加モデル・LoRAの3つで、ローカル環境が劇的に使いやすくなります。慣れてきたら ControlNet などの高度な拡張機能にも挑戦してみてください。

ローカルが難しい場合の代替案

「やっぱりPCスペックが足りない……」「インストールが不安……」という方には、こんな選択肢もあります。

| サービス | 特徴 | 料金 |

|---|---|---|

| Google Colab | クラウドでGPU利用 | 一部無料/月1,179円〜 |

| DreamStudio | 公式ブラウザ版 | 従量課金 |

| Mage.space | ブラウザで簡単 | 一部無料 |

| 生成AI GO | 日本語UI | 月額制 |

まずはブラウザ版で雰囲気を掴んで、本格的に使いたくなったらローカル環境に移行する、という流れもアリですね。

初心者さんへの選び方ガイド

・とりあえず触ってみたい → Mage.space(ブラウザでサクッと)

・GPUを借りて本格運用したい → Google Colab Pro

・将来的にローカルへ移行 → まずブラウザ版で慣れてから挑戦

・PCスペックOK → 最初からローカル環境がコスパ最強

ポイント

いきなりローカルに挑戦せず、ブラウザ版で試してから決めるのも賢い選択です。AI画像生成自体に慣れてからのほうがローカル設定もスムーズですよ。

よくある質問(FAQ)

Q1. Stable Diffusionは完全に無料で使えますか?

はい、ローカル環境で動かす場合は完全無料です。ソフトウェア自体がオープンソースで、モデル(SD1.5、SDXL Baseなど)も無料で配布されています。発生するのは電気代のみで、課金や月額料金は一切ありません。ただしGoogle ColabなどのクラウドGPUを使う場合は、別途利用料が必要です。

Q2. ノートPCでも動きますか?

NVIDIA製GPUを搭載したゲーミングノートPCなら動きます。VRAM 4GB以上、できれば8GB以上あると安心です。ただし内蔵GPU(Intel UHD Graphicsなど)しかないノートPCでは、CPU動作になり1枚あたり数分以上かかってしまいます。MacBookならM2 Pro以上が実用的なラインです。

Q3. Stable Diffusionで生成した画像は商用利用できますか?

基本的には商用利用OKですが、使うモデルのライセンス次第で条件が変わります。SDXL Baseは商用利用可能ですが、Civitaiで配布されているモデルの中には「個人利用のみ」「商用は要確認」のものもあります。各モデルのページでライセンス(Creative ML OpenRAIL-Mなど)を必ずチェックしてください。

Q4. AUTOMATIC1111版以外にもWeb UIはありますか?

はい、いくつかあります。代表的なのはComfyUI(ノードベースで上級者向け)とForge(AUTOMATIC1111の高速化フォーク)です。初心者にはAUTOMATIC1111版が情報量・拡張機能数ともに豊富で扱いやすいので、まずはここから始めるのがおすすめです。

Q5. Stable DiffusionとMidjourneyはどちらが初心者向けですか?

「とにかく綺麗な画像をすぐ作りたい」ならMidjourney、「無料で枚数無制限・自由にカスタマイズしたい」ならStable Diffusionです。Midjourneyはブラウザでプロンプトを打つだけで高品質な画像が出るので導入は簡単。一方でランニングコストがかかります。長く使うほどStable Diffusion(ローカル)のほうがコスパは良くなります。

まとめ:Stable Diffusionローカル環境で創作の幅を広げよう

ここまでお読みいただきありがとうございました。最後にポイントを振り返っておきますね。

この記事のおさらい

・Stable Diffusionは無料で使えるオープンソースの画像生成AI

・ローカル環境なら無料・無制限・プライバシー保護の3拍子

・GPU(VRAM)が最重要パーツ。RTX 3060以上が安心

・Python 3.10.6とGitを準備してから、AUTOMATIC1111版を導入

・トラブルは検索すれば解決策が見つかる

これだけは覚えておきたいポイント

- PythonはかならずVersion 3.10.6を選ぶ(最新版はNG)

- 「Add Python to PATH」のチェックを忘れずに

- 初回起動は10〜20分かかる。慌てず気長に

- VRAM不足は

--medvramオプションで緩和できる - 難しければ Google Colab やブラウザ版から始めてもOK

最初のセットアップは少し大変ですが、一度動かしてしまえば、あなただけの画像生成スタジオが手に入ります。アイデアを形にできる楽しさは、本当に病みつきになりますよ。

まずはこの記事を見ながら、小さな一歩を踏み出してみてくださいね。きっと「やってよかった」と思える体験が待っていますよ。

Kay(tool-123編集部)

AI活用で忙しい毎日にちょこっと余白を作る方法を発信中。30ツール以上を実際に試して、等身大の目線でレビューしています。

tool-123(AIツールナビ) / AI初心者さんの「最初の1歩」を応援

最後まで読んでくださって、ありがとうございました。

コメント